Toen sociale media opkwamen, was de strijd vooral: wie mag welke data zien, wie kan wat delen, wie slaat welke logs op. Met de komst van krachtige AI en generatieve modellen is er een nieuwe grens: niet alleen wordt je data gebruikt om je advertenties te tonen, maar wordt AI getraind met jouw data om het model zelf beter te maken, en dat gaat veel verder dan profilering.

Een model dat wordt getraind op je profiel, berichten, foto’s, commentaren of gedrag leert patronen, associaties en verbanden. Dat betekent dat zelfs jouw acties, ook die je mogelijk niet denkt dat “zinnig” zijn bijdragen aan de kennisbasis van AI’s die straks antwoorden kunnen genereren over allerlei onderwerpen. En als jouw data ooit in een model zit, is het in de praktijk vaak onmogelijk om die “eruit” te halen. De Autoriteit Persoonsgegevens waarschuwt dan ook dat deze AI‑trainingsdata moeilijk te wissen zijn zodra ze in een model terecht zijn gekomen.

Daar komt bij: veel van deze AI‑trainingsopties zijn standaard aan gezet. Gebruikers worden vaak geacht actief “uit te zetten” (opt‑out)en wie ie niet oplet, wordt automatisch ingeschreven. LinkedIn is daar een actueel voorbeeld van: vanaf 3 november 2025 wil LinkedIn onder meer in Europa profielgegevens en openbare content van leden gebruiken voor AI‑methodes, tenzij je bezwaar maakt. LinkedIn liet even snel een pop-up schermpje zien waarin ze dit aankondigde. Alsof het niets is.

De consequentie is dat wie zijn privacy wil beschermen, extra waakzaam moet zijn: je moet niet alleen letten op wat je deelt, maar ook op welke standaardinstellingen worden geactiveerd, en je moet steeds navigeren in complexe privacy‑menu’s om je bezwaar kenbaar te maken.

LinkedIn: AI‑training uitschakelen

LinkedIn wil onder andere je profielinformatie (naam, foto, functies, werkervaring, vaardigheden), je openbare content (posts, reacties, polls) en de input die je in AI‑hulpmiddelen (zoals schrijfassistent) geeft, inzetten voor het trainen van AI‑modellen.

In Nederland (en EU) waarschuwt de Autoriteit Persoonsgegevens dat deze data vanaf 2003 kan worden betrokken in de AI-modellen, en dat je vóór 3 november 2025 bezwaar moet maken om te voorkomen dat je toekomstige gegevens gebruikt worden.

Hoe LinkedIn uitschakelen / bezwaar maken

- Ga naar LinkedIn → klik op jouw profielfoto / “Ik” → Instellingen & Privacy

- Ga naar het tabblad Gegevensprivacy

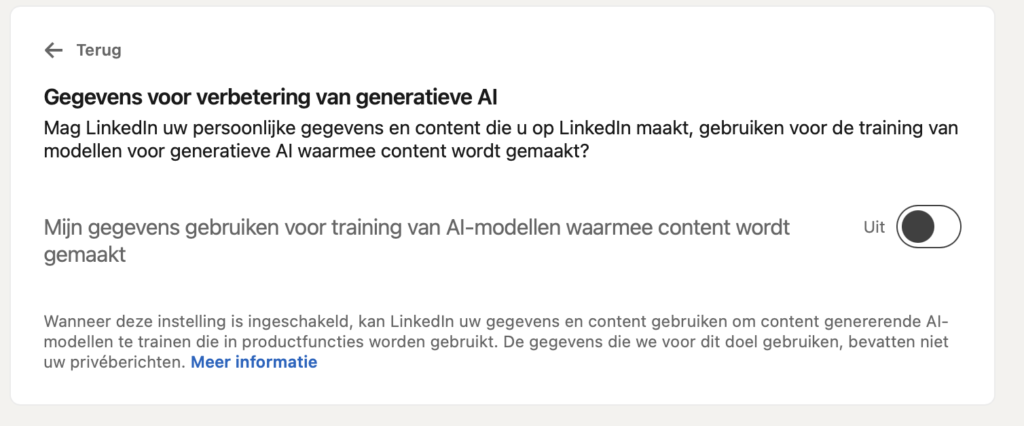

- Zoek de optie “Gegevens voor verbetering van generatieve AI” (of in het Engels “Data for Generative AI Improvement” / “How LinkedIn uses your data”)

- Zet de schakelaar uit (“off”) om te voorkomen dat je toekomstige data gebruikt wordt.

- Zorg dat je dit vóór 3 november hebt gedaan, want anders wordt je automatisch ingeschakeld.

Let op: het bezwaar geldt alleen voor toekomstige gegevens. Gegevens die al zijn gebruikt voor AI-training kunnen vaak niet meer verwijderd worden uit de modellen.

Als extra route kun je (zeker als je denkt dat je rechten geschonden zijn) een beroep doen op een formeel bezwaarschrift of klacht bij LinkedIn of de relevante privacy‑toezichthouder (in Europa is dat vaak de Ierse DPC, vanwege de hoofdvestiging van LinkedIn in de EU).

Meta (Facebook & Instagram): AI‑training tegengaan

Meta stelt dat het publieke posts, reacties, profielfoto’s en audio kan gebruiken om AI-modellen te trainen, inclusief zijn “Meta AI” functies maar beweert dat privéberichten niet gebruikt worden.

In de EU is er sinds juni 2024 een regeling dat gebruikers bezwaar kunnen maken tegen het gebruik van hun openbare content voor AI-training.

Het obstakel is dat het proces niet altijd eenvoudig is: het kan zijn dat je een formulier moet invullen waarin je beschrijft welke persoonlijke data je bezwaar geeft, en je moet soms bewijzen (screenshots) dat die data is gebruikt in AI-responses.

Er zijn meldingen dat het formulier in de praktijk soms niet werkt, bijvoorbeeld doordat verificatie per e‑mail stokt, of dat Meta vraagt naar voorbeelden van hoe jouw data gebruikt is, wat niet altijd te leveren is.

Hoe bezwaar maken bij Meta (Facebook / Instagram)

Voor EU / UK gebruikers is de meest gangbare route:

- Ga naar de instellingen van Facebook of Instagram

- Zoek naar Privacy / Privacy Center / AI bij Meta

- Kies de optie Submit an objection / object to data use for AI (of “Your Right to Object”)

- Vul het formulier in met je e‑mail, reden (bijv. “I don’t want my data used to train AI”) en verzend

- Wacht op bevestiging of terugkoppeling van Meta dat je bezwaar is gehonoreerd.

Als je een notificatie over AI-training hebt gekregen, kun je daarin vaak direct op “Right to object” klikken om naar het formulier te gaan.

Beperkingen en aandachtspunten:

Dit bezwaar dekt meestal alleen toekomstige AI‑training, niet wat al verwerkt is.

Meta kan nog steeds afbeeldingen of tekst waarin je voorkomt, delen als anderen jou taggen of posten over jou. In sommige landen (bijv. buiten de EU) is geen dergelijke opt‑out beschikbaar. Sommige gebruikers melden ook dat het e‑mailverificatieproces of de werking van het formulier niet betrouwbaar is.

Als extra stap kun je je account zo privé mogelijk maken: beperk wie je openbare posts kan zien, verwijder oude publieke inhoud, en gebruik zo weinig mogelijk openbare interacties.

Waarom dit niet eenvoudig is (en wat je verder kunt doen)

Modellen zijn “geheugen”: eenmaal verwerkt in een model, is het vaak onmogelijk om data eruit te filteren. Versleuteling & anonymisering hebben limieten: zelfs gedeeltelijk geanonimiseerde of geaggregeerde data kan soms herleid worden naar individuen.

Transparantie & toezicht: bedrijven geven vaak weinig inzicht in welke data precies gebruikt wordt, en hoe je uitsluiting “werkt”.

Regionale grenzen: in de EU bestaat bescherming via de AVG (GDPR), maar elders zijn de rechten beperkt of afwezig.

Complexe opt-out-procedures: formulieren, verificaties, en bewijsvoering vormen obstakels waardoor veel gebruikers afhaken.

Als gebruiker kun je verder:

- Bewust omgaan met wat je deelt en wat je openbaar maakt

- Regelmatig je privacy‑instellingen controleren

- Tijdig bezwaar maken bij nieuwe privacywijzigingen

- Contact zoeken met privacyautoriteiten of belangenorganisaties

- In sommige gevallen overwegen op alternatieve platforms met sterkere privacy‑garanties

Conclusie

Met de opkomst van AI staat privacy onder extra druk: het gaat niet langer alleen om wie je profielgegevens ziet, maar om wie ze gebruikt voor het scherpen van zelflerende systemen. Diensten zoals LinkedIn en Meta zetten standaard de AI‑trainingsopties aan, waardoor je zelf actie moet ondernemen om je data te beschermen.

De goede nieuws is dat er mogelijkheden zijn om bezwaar te maken maar de route is vaak (expres) onduidelijk, omslachtig of beperkt in effect. Dus: wees alert, handel snel bij meldingen, en houd de ontwikkelingen in de gaten.